L’internet a rendu plus facile que jamais la rencontre et la diffusion de théories du complot. Et si certaines sont inoffensives, d’autres peuvent être profondément nuisibles, semant la discorde et entraînant même des morts inutiles.

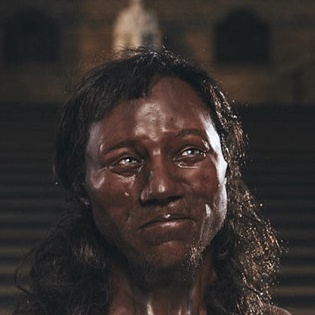

Aujourd’hui, des chercheurs pensent avoir découvert un nouvel outil pour lutter contre les fausses théories du complot : les chatbots d’IA. Des chercheurs du MIT Sloan et de l’université Cornell ont constaté que le fait de discuter d’une théorie du complot avec un grand modèle de langage (LLM) réduisait la croyance des gens en cette théorie d’environ 20 %, même chez les participants qui affirmaient que leurs croyances étaient importantes pour leur identité. Cette étude est publiée aujourd’hui dans la revue Science.

Selon Yunhao (Jerry) Zhang, chercheur postdoctoral affilié à l’Institut de psychologie de la technologie, qui étudie l’impact de l’IA sur la société, ces résultats pourraient constituer une avancée importante dans la manière d’aborder et d’éduquer les personnes qui adhèrent à de telles théories infondées.

Vu les coms sur la question du patriarcat, nous venons de nouer un partenariat avec chatgpt afin de nous déconstruire.

#CeciEstUnTroll

“Ils montrent qu’avec l’aide de grands modèles de langage, nous pouvons - je ne dirais pas résoudre le problème, mais nous pouvons au moins l’atténuer”, déclare-t-il. "C’est un moyen d’améliorer la société.

Selon Thomas Costello, chercheur au MIT Sloan et auteur principal de l’étude, peu d’interventions ont prouvé qu’elles pouvaient faire changer d’avis les théoriciens de la conspiration. Ce qui rend la tâche si difficile, c’est que les gens ont tendance à s’accrocher à différentes parties d’une théorie. En d’autres termes, si la présentation de certains éléments factuels peut être efficace pour un croyant, rien ne garantit qu’elle le sera pour un autre.

C’est là que les modèles d’intelligence artificielle entrent en jeu. “Ils ont accès à une multitude d’informations sur divers sujets et ont été formés sur l’internet. De ce fait, ils ont la capacité d’adapter des contre-arguments factuels à des théories du complot particulières auxquelles les gens croient”.

L’équipe a testé sa méthode en demandant à 2 190 travailleurs issus du crowdsourcing de participer à des conversations textuelles avec GPT-4 Turbo, le dernier grand modèle linguistique d’OpenAI.

Les participants ont été invités à donner des détails sur une théorie du complot qu’ils jugeaient crédible, à expliquer pourquoi ils la trouvaient convaincante et à fournir des preuves à l’appui de cette théorie. Ces réponses ont été utilisées pour adapter les réponses du chatbot, que les chercheurs avaient incité à être aussi persuasif que possible.

Après chaque conversation, les participants devaient répondre aux mêmes questions d’évaluation. Les chercheurs ont relancé tous les participants dix jours après l’expérience, puis deux mois plus tard, afin de déterminer si leur point de vue avait changé à la suite de la conversation avec le robot. Les participants ont indiqué qu’ils croyaient en moyenne 20 % moins à la théorie du complot qu’ils avaient choisie, ce qui suggère que la conversation avec le robot a fondamentalement changé l’esprit de certaines personnes.

Même en laboratoire, 20 % représentent un effet important sur les croyances des gens", explique M. Zhang. "Il pourrait être plus faible dans le monde réel, mais même 10 % ou 5 % seraient encore très importants.

Les auteurs ont cherché à se prémunir contre la tendance des modèles d’IA à inventer des informations - connue sous le nom d’hallucination - en faisant appel à un vérificateur de faits professionnel pour évaluer l’exactitude de 128 affirmations faites par l’IA. Parmi celles-ci, 99,2 % se sont révélées vraies, tandis que 0,8 % ont été jugées trompeuses. Aucune affirmation n’a été jugée complètement fausse.

Selon David G. Rand, professeur au MIT Sloan qui a également travaillé sur le projet, ce degré élevé de précision s’explique par le fait que les théories du complot ont fait couler beaucoup d’encre sur l’internet, ce qui fait qu’elles sont très bien représentées dans les données d’entraînement du modèle. La nature adaptable de GPT-4 Turbo signifie qu’il pourrait facilement être connecté à différentes plateformes avec lesquelles les utilisateurs pourraient interagir à l’avenir, ajoute-t-il.

“On pourrait imaginer qu’il suffise d’aller sur des forums de conspiration et d’inviter les gens à faire leurs propres recherches en débattant avec le chatbot”, explique-t-il. De même, les médias sociaux pourraient être connectés aux LLM pour publier des réponses correctives aux personnes partageant des théories conspirationnistes, ou nous pourrions acheter des annonces de recherche Google contre des termes de recherche liés à la conspiration tels que “État profond”.

Selon Gordon Pennycook, professeur associé à l’université de Cornell qui a également participé au projet, cette étude a bouleversé les idées préconçues des auteurs sur la réceptivité des gens aux preuves solides qui démystifient non seulement les théories du complot, mais aussi d’autres croyances qui ne sont pas fondées sur des informations de bonne qualité.

“Les gens ont été remarquablement réceptifs aux preuves. Et c’est très important”, ajoute-t-il. "Les preuves ont de l’importance

deleted by creator

Très intéressant, merci !